Nedávné pokroky v AI nepřinesly jen sofistikovanější a chytřejší chatboty, ale přinesly také významné výzvy, zejména s nárůstem deepfakes. Zatímco mnoho z těchto vykreslení AI je vygenerováno dodatečně, nový je o stupeň lepší díky výměně AI v reálném čase, kterou lze využít během videohovorů.

Nový projekt umělé inteligence nazvaný Deep-Live-Cam se nedávno prosadil online pro část jeho funkce, která spočívá v aplikaci deepfakes na webové kamery. Zároveň to vyvolalo diskuse o možných bezpečnostních rizicích a etických důsledcích, které to přináší.

Jak se Deep-Live-Cam liší od ostatních deepfake programů

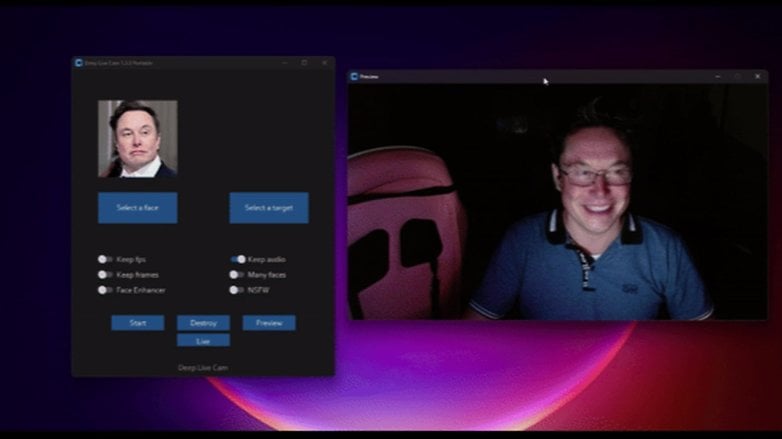

Deep-Live-Cam v podstatě používá pokročilé algoritmy umělé inteligence, které dokážou pořídit fotografii z jednoho zdroje a aplikovat obličej na cíl během živých videohovorů, například na webových kamerách. Zatímco je projekt stále ve vývoji, první testy již ukazují znepokojivé a působivé výsledky.

Jak je dále popsáno na Ars Technica, aplikace nejprve čte a detekuje tváře ze zdroje a cílového předmětu. Poté používá model výměny k výměně tváří v reálném čase, zatímco jiný model zlepšuje kvalitu tváří a přidává efekty, které se přizpůsobují měnícím se světelným podmínkám a výrazům tváře. Tento sofistikovaný proces zajišťuje, že konečný produkt je vysoce realistický a není snadno rozpoznatelný jako padělek.

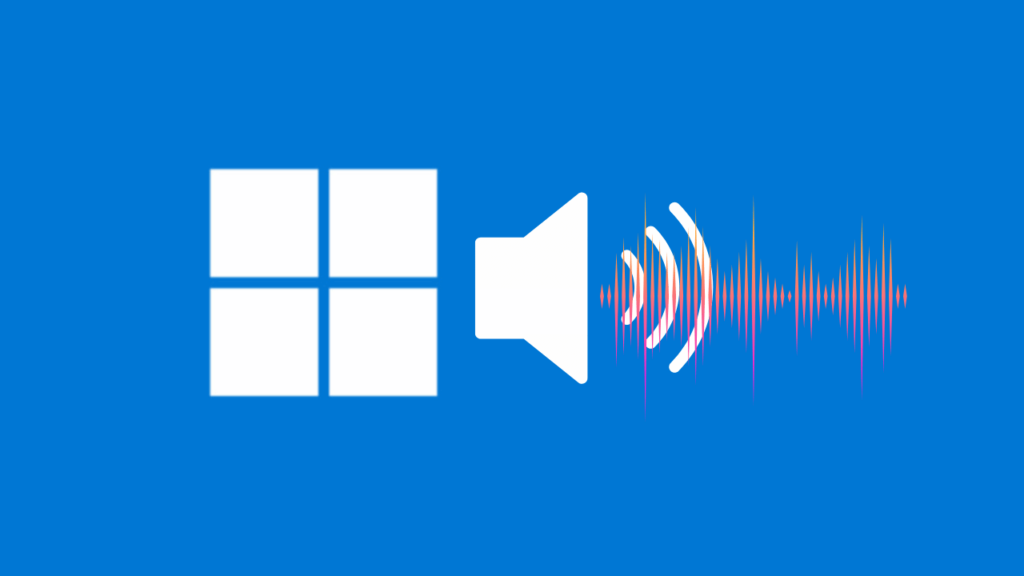

Příklad fúze obličeje pomocí Elona Muska jako zdroje / © GitHub / Ars Technica

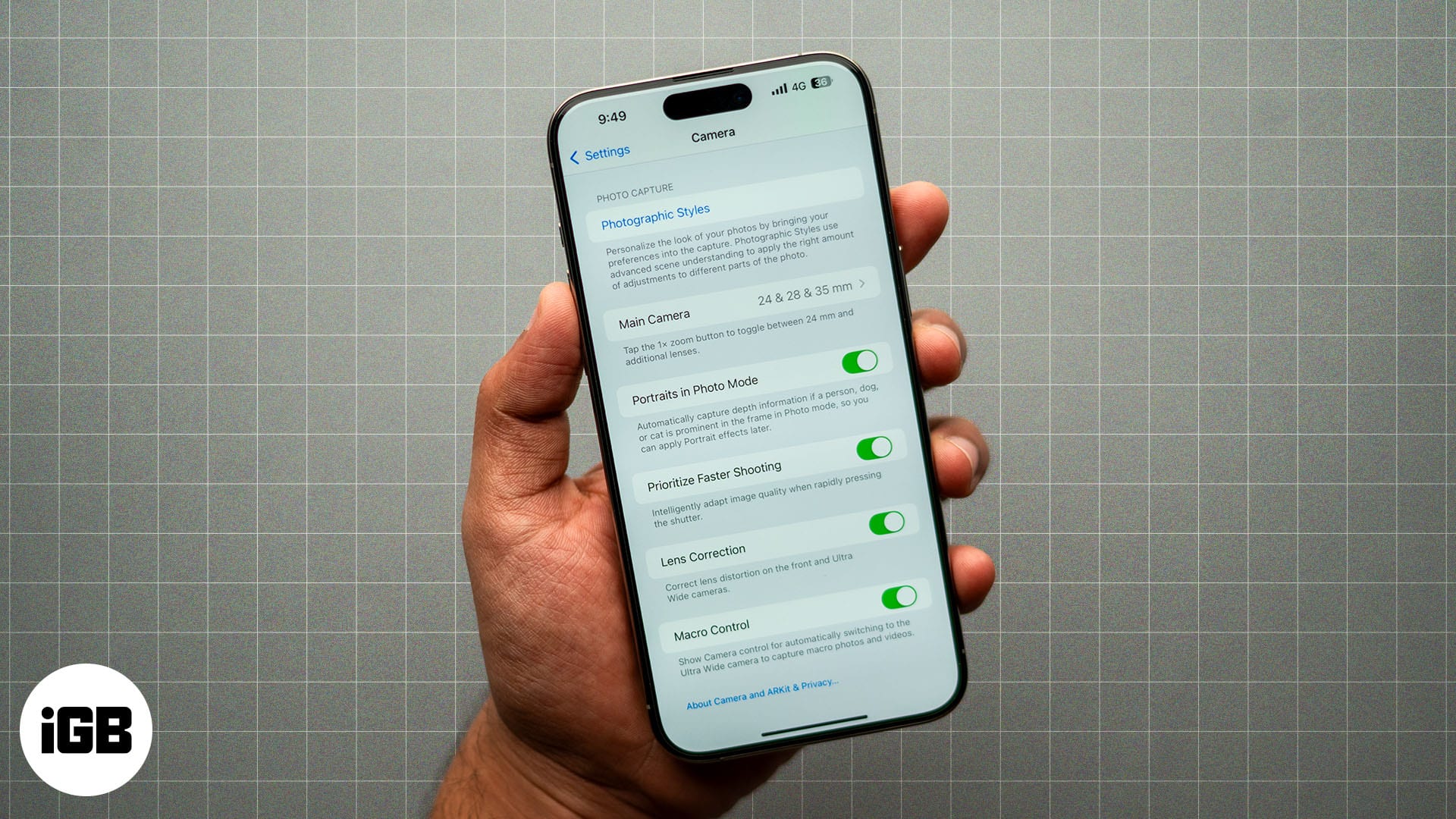

Například jeden z klipů sdílených vývojářem ukázal realistickou fúzi tváře generálního ředitele Tesly Elona Muska s předmětem. Hluboká fake dokonce zahrnovala překrytí dioptrických brýlí a vlasy subjektu, díky čemuž byla neuvěřitelně přesvědčivá. Další ukázaný příklad byl s tváří amerického kandidáta na viceprezidenta JD Vance a Marka Zuckerberga z Meta.

Fúze tváře kandidáta na amerického viceprezidenta JD Vance pomocí Deep-Live-Cam / © X/u/Orange AI

Měli byste se obávat vzestupu aplikací pro simulaci umělé inteligence?

Proč se to tedy konkrétně týká? Používání Deel-Live-Cam a dalších deepfake aplikací v reálném čase vyvolává vážné obavy o soukromí a bezpečnost. Představte si, že váš obrázek může být stažen z internetu a použit k podvodům, podvodům a jiným škodlivým činnostem bez vašeho svolení.

Právě teď je vidět, že nedostatky lze vyřešit několika způsoby, jako je zahrnutí vodoznaků při používání aplikace a robustní metody detekce. Řešení lze použít i na další deepfake programy a aplikace.

Zájem o nástroj jej rychle přenesl na seznam trendových projektů na GitHubu.

Jaký je váš názor na aplikace pro simulaci umělé inteligence v reálném čase? Chcete se podělit o postupy, jak se chránit před těmito potenciálními riziky? Rádi bychom slyšeli vaše odpovědi v komentářích.

Přes: Arstechnica