Klíčové poznatky:

- Pomocí nástrojů, jako je Ollama, můžete využít možnosti modelů umělé inteligence s otevřeným zdrojovým kódem přímo na vašem zařízení.

- Když budete tyto modely umělé inteligence provozovat lokálně, obejdete se bez závislosti na cloudu a získáte výhody, jako je soukromí a rychlejší vyvozování.

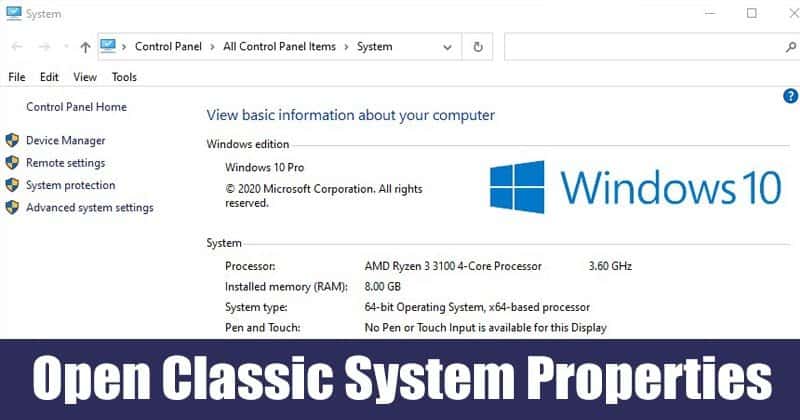

Jak spouštět modely AI lokálně v systému Windows pomocí Ollama

Modely AI, jako je ChatGPT, můžete spouštět lokálně na svém počítači bez připojení k internetu. S tímto procesem vám pomůže spousta služeb. My si to však předvedeme pomocí Ollama.

Stáhněte a nainstalujte Ollama

Krok 1: Přejděte na Web Ollama a klikněte na tlačítko Stáhnout.

Krok 2: Vyberte svůj operační systém a klikněte na Stáhnout.

Krok 3: Dvakrát klikněte na stažený soubor > klikněte na Instalovat > postupujte podle pokynů k instalaci.

Po instalaci byste měli vidět vyskakovací okno se zprávou, že Ollama běží.

Krok 4: Spusťte svůj terminál. Ve Windows stiskněte Windows + R, napište cmd a stiskněte Enter.

Krok 5: Stáhněte si svůj první model AI pomocí příkazu níže. Ujistěte se, že jste nahradili model skutečným modelem na Ollama; mohou to být Llama 3, Phi 3, Mistral, Gemma atd. Buďte trpěliví; může to chvíli trvat.

Ollama pull model

Jak komunikovat se staženými modely na Ollama

Nyní, když jste nainstalovali model AI, můžete s ním komunikovat. Je to podobné jako při komunikaci s Gemini nebo ChatGPT AI z webových rozhraní. Postupujte podle níže uvedených kroků.

Krok 1: Spusťte Terminál v počítači.

Krok 2: Zadejte příkaz níže. Název modelu, který jste si stáhli, můžete v příkazu nahradit lamou3.

Ollama run llama3

Krok 3: Nakonec zadejte výzvu a stiskněte Enter jako na ChatGPT nebo Gemini. Poté byste měli být schopni komunikovat s AI.

FAQ

Můžete spustit generativní umělou inteligenci lokálně?

Ano, můžete a v současné době je stabilní difúze nejspolehlivějším prostředkem. Nástroje jako Stabilní difúzní WebUI a InvokeAI umožnit přístup ke Stable Diffusion pro lokální generování obrazu.